Новая нейросеть от Meta* обогнала ChatGPT-4 по производительности в ИИ–тестах

Meta* выпустила новую нейросеть Llama 3.1 с открытым исходным кодом, насчитывающую более 400 млрд различных параметров. Модель умеет генерировать изображения и текст.

«В отличие от закрытых моделей, все модели Llama доступны для загрузки. Разработчики могут полностью настраивать нейросети для своих нужд и приложений, обучаться на новых наборах данных и проводить дополнительную настройку», — сообщила компания в своем блоге.

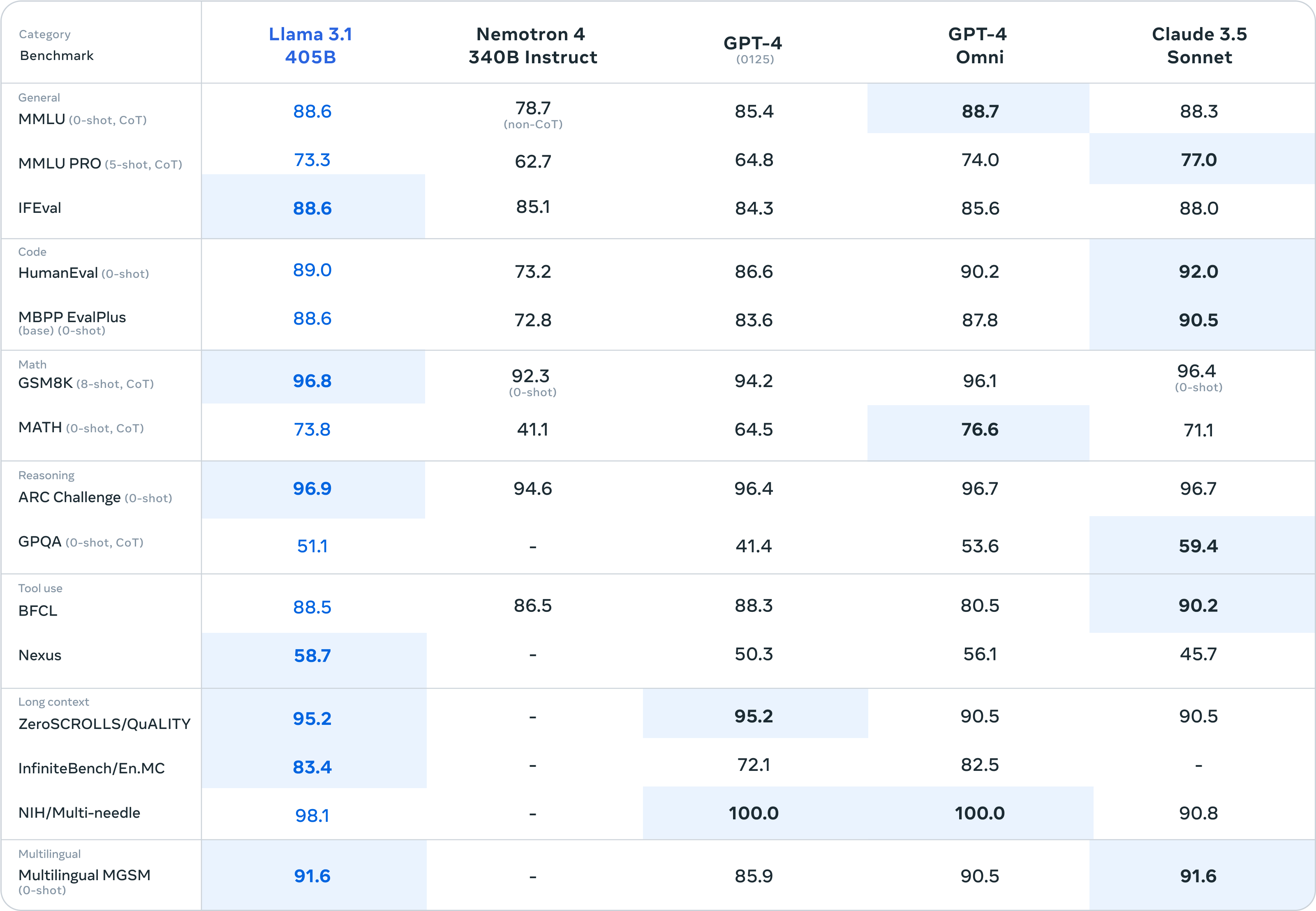

Также, по словам разработчиков, Llama 3.1 превосходит альтернативные ИИ-модели — GPT-4o и Claude 3.5 Sonnet от OpenAI и Anthropic соответственно — по производительности в таких задачах, как рассуждение, руководство, математика и многоязычный перевод.

Meta* заявляет, что Llama 3.1 обучалась более чем на 16 тыс. графических процессоров Nvidia H100, а также на большем количестве неанглийских данных, «математических данных» и кода (для улучшения навыков математического мышления модели) и последних веб-данных (для улучшения знаний о текущих событиях).

«Как и ожидалось по законам масштабирования для языковых моделей, наша новая флагманская модель превосходит меньшие модели, обученные с использованием той же процедуры. Мы также использовали модель параметров 405B для улучшения качества постобучения наших меньших моделей», — отметила компания.

Пользователи могут протестировать Llama 3.1 на сайте Meta AI*, в чат-боте компании, а в отдельных странах в Facebook*, Instagram* и WhatsApp. Также нейросеть, как заявляют разработчики, доступна у партнеров компании, включая AWS, Nvidia, Databricks, Groq, Dell, Azure и Google Cloud.

Ранее OpenAI показала новую нейросеть для работы с большим объемом данных. Она представлена как «экономичная версия» GPT4o.

*Компания Meta признана экстремистской и запрещена на территории РФ